生成模式

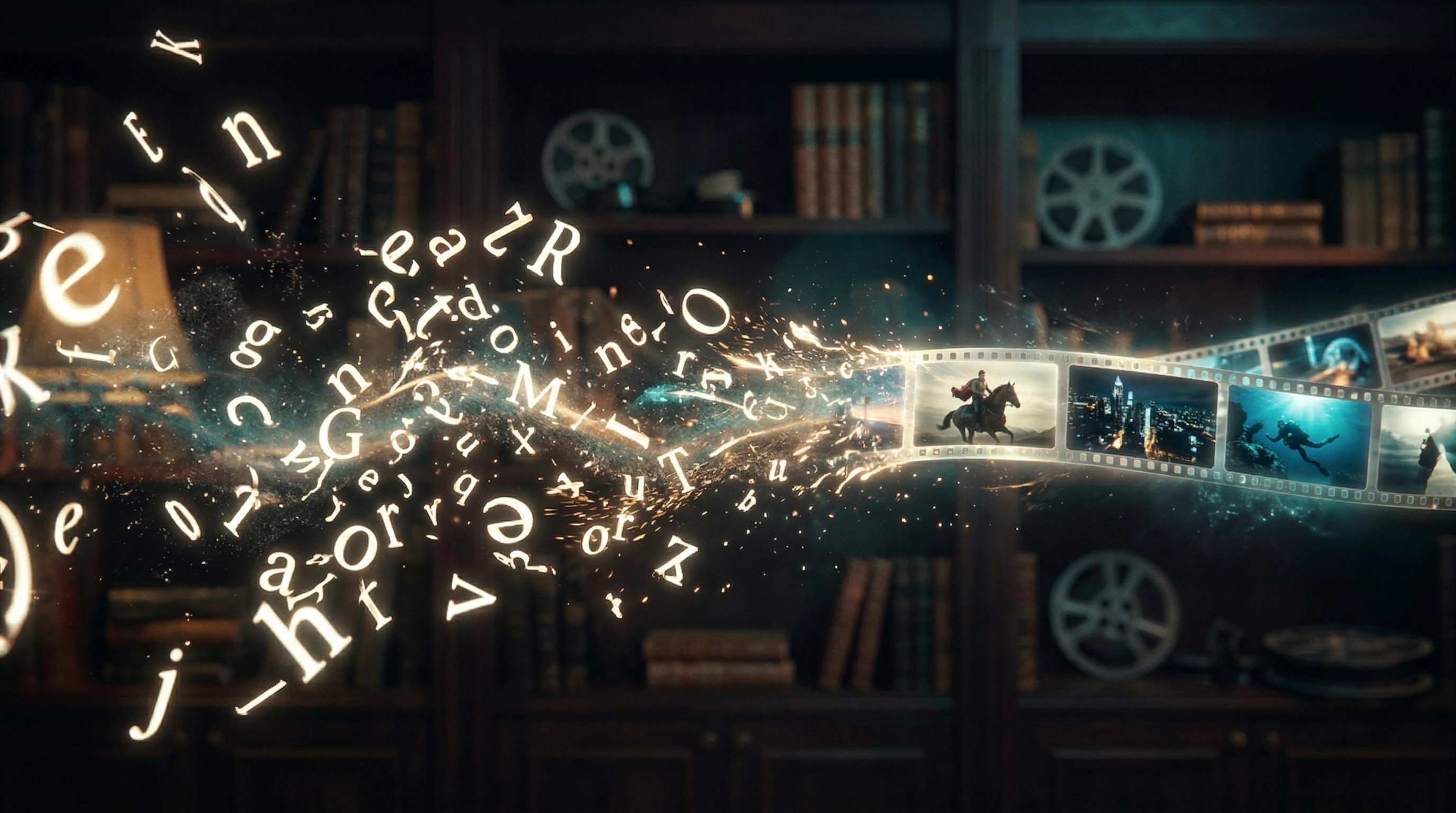

Verified文生视频允许用户直接从书面文本描述中生成视频剪辑,无需任何源图像

Key facts

文生视频允许用户直接从书面文本描述中生成视频剪辑,无需任何源图像

据报道,HappyHorse 支持生成最高 1080p 分辨率的视频

该模型使用 8 步去噪过程,这比许多竞争模型所需的步骤更少,表明其生成速度更快

与所有 AI 视频模型一样,输出质量在很大程度上取决于提示词的具体程度和结构

推荐工具

通过对初学者友好的 AI 动画工作流,将您所学到的知识付诸实践。

由 Elser.ai 提供支持 — 作为本指南之后实用的后续步骤。

尝试 AI 图像动画师Mixed signal

教程内容基于公开可用的信息。随着更多信息的官方确认,部分工作流细节可能会有所变动。

Readers should expect careful wording here because public reporting confirms the topic, while some product details still need cautious treatment.

“文生视频”(Text-to-video)是 HappyHorse 的核心生成模式。本教程涵盖了编写有效提示词并从模型中获得最佳输出所需的一切知识。

文生视频功能通过书面描述来生成视频剪辑。据报道,HappyHorse 模型使用了一个 15B 参数的 Transformer 和 8 步去噪流水线,将噪声转化为连贯的视频帧。去噪步骤越少,通常意味着生成时间越短,这也是 HappyHorse 受到关注的原因之一。

基本流程:

影响输出质量的最大因素是提示词的质量。请遵循以下结构:

主体 (Subject) + 场景 (Setting) + 动作/动态 (Action/Motion) + 镜头 (Camera) + 氛围/光影 (Mood/Lighting) + 时长 (Duration)

每个元素都能增加控制力。缺失元素会让模型有更多的主观发挥空间,虽然有时会产生意想不到的惊喜,但更多时候会导致结果模糊不清。

对所出现的人物或事物要具体:

将场景放置在具体地点:

描述剪辑过程中发生的事情:

指明镜头类型和移动方式:

设定环境氛围:

虽然 HappyHorse 界面的具体设置尚不确定,但大多数 AI 视频工具都提供以下控制选项:

在生成第一个结果后,根据以下标准进行评估:

如果以上任何问题的答案是否定的,请调整提示词的相关部分并重新生成。

提示词:“一只秃鹰在黎明时分翱翔在雾气缭绕的山湖之上,翅膀完全展开,缓慢滑行,背后的空中跟踪镜头,金色的日出光线穿过云层,史诗般的自然纪录片基调,5 秒”

预期输出:一只写实的鹰在反射水的湖面上平滑滑行,伴有体积雾和温暖的逆光。镜头平稳跟随。主要挑战领域:羽毛细节、翅膀几何形状的连贯性、水面反射的连贯性。

提示词:“一个哑光黑色无线耳机在白色大理石底座上缓慢旋转,摄影棚灯光,左侧有一道强烈的关键光,平滑的 360 度旋转,奢华产品广告感,浅景深,4 秒”

预期输出:简洁的产品镜头,旋转过程中物体几何结构连贯。反射和阴影应保持稳定。由于场景简单且运动可预测,此类提示词通常效果较好。

提示词:“一名动漫剑客在雨夜跳下城市屋顶,斗篷在身后飘扬,霓虹灯倒映在下面的水坑中,动态低角度仰拍,激烈的动作动漫光影,边缘光和动态模糊,3 秒”

预期输出:具有戏剧性姿势和夸张运动的动漫风格角色。霓虹色调,带有雨水效果。较短的时长有助于在快节奏动作中保持连贯性。

提示词:“特写:咖啡倒入带有冰块的透明玻璃杯中,奶油缓慢旋转混合,俯视镜头角度,明亮的窗户自然光,舒适的咖啡馆美学,9:16 竖屏格式,3 秒”

预期输出:慢动作中令人满意的液体物理效果。俯视角度避免了复杂的透视挑战。短时长保持了慢动作效果的紧凑性。液体和玻璃透明度对任何模型来说都是高要求。

最好的文生视频结果几乎从来不是一次性生成的。请使用此迭代周期:

请认清 HappyHorse 和所有当前 AI 视频模型存在的客观局限性:

本网站是一个独立的资讯资源,并非 HappyHorse 的官方网站或服务。

获取 50 多条经过测试的 AI 视频提示词、对比速查表以及工作流模板,直接发送到您的邮箱。

FAQ

一个强有力的提示词应包含清晰的主题、具体的场景、定义的动作或行为、镜头运动、光影与氛围细节,以及可选的时长建议。在所有 AI 视频模型中,明确的细节总是能产生更好的结果。

最大片段时长尚未正式确认。根据同类模型,建议生成 3 到 10 秒的片段,因为较短的时长往往能保持更好的连贯性。

据报道 HappyHorse 支持 1080p 输出。具体的长宽比控制尚未确认,但 16:9 横屏和 9:16 竖屏是大多数 AI 视频生成工具的标准选项。

模糊或相互矛盾的指令是最常见的原因。尝试对主题描述得更具体,删除矛盾的细节,并将复杂的场景分解为更简单的构图。